Wraz z wykorzystaniem sztucznej inteligencji (ang. Artificial Intelligence – AI) w branży energetycznej rośnie szereg możliwości, ale i problemów związanych z tym faktem. Open AI osiągnęło niesamowity sukces i w ciągu dwóch miesięcy uzyskało liczbę użytkowników chatGPT przekraczającą 100 mln[1]. Także Microsoft i Alphabet wprowadziły własne chatboty – Bing Chat[2] i Bard (aktualnie Gemini)[3]. Jednym z najistotniejszych problemów powiązanych z rozwojem AI jest zwiększone zużycie energii elektrycznej przeznaczonej do wytrenowania oraz późniejszego użytkowania coraz bardziej skomplikowanych modeli.

Źródło: zdjęcie wygenerowane przez AI

Co więcej – w przyszłości zapotrzebowanie na energię ze strony systemów AI może przewyższyć poziomy zużycia energii elektrycznej obserwowane w niektórych mniejszych krajach! Przewiduje się, że w 2027 roku do zasilenia AI będzie potrzeba od 85 do 134 TWh (terawatogodzin) energii rocznie[1]. Jest to porównywalne z aktualnym zużyciem prądu przez takie kraje jak Finlandia i Belgia (w przypadku dolnej wartości) lub Argentyna, Szwecja (w przypadku górnej wartości)[4], natomiast w Polsce w roku 2023 wyprodukowano ilość energii elektrycznej wynoszącą 163 TWh[5].

Wygląda na to, że w ciągu zaledwie kilku lat AI może zużywać od ponad połowy do 82% całkowitej rocznej obecnej produkcji energii elektrycznej w naszym kraju.

Zapytanie standardowej wyszukiwarki 10 razy bardziej oszczędne niż genAI?

Faza uczenia modeli sztucznej inteligencji, często uważana za najbardziej energochłonną, była głównym przedmiotem badań nad zrównoważonym rozwojem sztucznej inteligencji[6]. Firma badawcza SemiAnalytics zasugerowała, że OpenAI wymagało 3617 serwerów NVIDIA HGX A100 z łącznie 28 936 procesorami graficznymi (GPU) do obsługi ChatGPT, co oznacza zapotrzebowanie na energię na poziomie 564 MWh dziennie w fazie użytkowania i przewidywanego zużycia na poziomie 1287 MWh dziennie w fazie uczenia[1]. Tylko GenAI zużywa w zapytaniu od 10 do 100 razy więcej energii niż e-mail[7], nie mówiąc tu o innych firmach, które będą tworzyć lub już tworzą oprogramowanie i dodatkowe rozwiązania bazujące na sztucznej inteligencji w celu osiągnięcia przewagi konkurencyjnej.

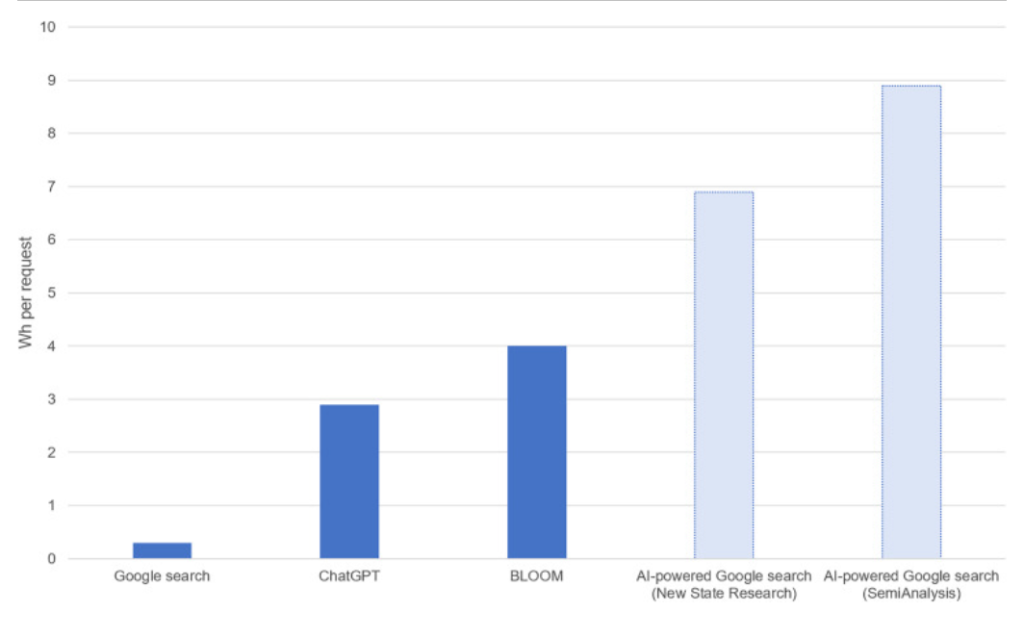

Rys. 1. porównuje różne szacunki zużycia energii elektrycznej podczas interakcji z wielkimi modelami tekstowymi (ang. Large Language Model- LLM) w porównaniu z użyciem standardowej wyszukiwarki Google. Prezes Alphabet wskazał w lutym 2023 r., że interakcja z LLM będzie „prawdopodobnie kosztować 10 razy więcej niż standardowe wyszukiwanie słów kluczowych”, a standardowa wyszukiwarka Google zużywa 0,3 Wh energii elektrycznej. Celem porównania: zużycie energii elektrycznej na bazie wielkich modeli tekstowych AI (LLM) plasuje się na poziomie około 3 Wh. Liczba ta jest zgodna z oceną kosztów operacyjnych ChatGPT przeprowadzoną przez SemiAnalytics na początku 2023 r., według której ChatGPT odpowiada na 195 milionów żądań dziennie, co jak już wspomniano wyżej, wymaga szacowanego średniego zużycia energii elektrycznej na poziomie 564 MWh dziennie, czyli około 2,9 Wh na jedno żądanie.

Rys. 1. Szacowane zużycie energii na jedno żądanie dla różnych systemów opartych na sztucznej inteligencji w porównaniu ze standardową wyszukiwarką Google. Źródło[1]

Butelka wody na schłodzenie genAI

Jedną z przeszkód, z jaką wiąże się stosowanie sztucznej inteligencji w sektorze energetycznym, jest potrzeba chłodzenia centrów danych (ang. Data center). Centra danych to zaawansowane technologicznie obiekty, które zarządzają operacjami systemów AI, wytwarzając dużą ilość ciepła, co zmusza z kolei do poszukiwania efektywnych rozwiązań chłodzących. Kluczowym elementem tych systemów jest woda, co budzi niepokój wśród obrońców środowiska.

Źródło: pl.freepik.com

Microsoft podał, że rozwój technologii sztucznej inteligencji zwiększył zapotrzebowanie na wodę o 34% pomiędzy 2021 a 2022 rokiem[8]. Tylko proces trenowania ChatGPT-3 wymagał użycia 700 tysięcy litrów wody. Ocenia się, że interakcja z czatbotem, podczas której użytkownik zadaje od 5 do 50 pytań, prowadzi do zużycia przez systemy AI około 500 ml wody[8].

W 2023 r. producent chipów NVIDIA odnotował rekordowe przychody w drugim kwartale za rozwiązania oparte na sztucznej inteligencji: 13,5 miliarda dolarów za 3 miesiące[9]. W szczególności 141% wzrost użycia w segmencie centrów danych firmy, w porównaniu z poprzednim kwartałem, podkreśla rosnący popyt na produkty AI, potencjalnie prowadząc do znacznego wzrostu śladu energetycznego AI. Na przykład firmy takie jak Google, należące do Alphabet, mogą znacznie zwiększyć swoje zapotrzebowanie na energię, gdyby generatywna sztuczna inteligencja została zintegrowana z każdym standardowym wyszukiwaniem lub innym rozwiązaniem nie mającym jeszcze bezpośredniego wsparcia AI.

Kryptowaluty vs. genAI – co pochłania więcej energii?

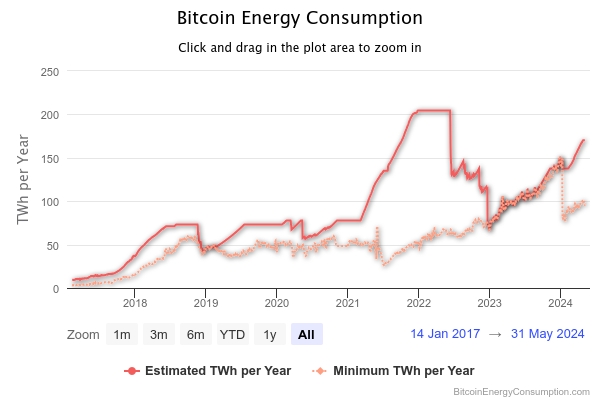

W przypadku kryptowalut Cambridge Blockchain Network Sustainability Index: CBECI szacuje, że globalne zużycie energii elektrycznej związane z użytkowaniem Bitcoinów wahało się od 67 TWh do 240 TWh w 2023 r., przy punktowym szacunku 120 TWh[10]. Inne badanie ONZ sugeruje, że globalne użytkowanie kryptowaluty Bitcoin wymaga zużycia większej ilości energii elektrycznej niż w wielu wysoko zaludnionych krajach, jak na przykład w Pakistanie[11].

Prognozy z lipca tego roku przewidywały, że do produkcji i użytkowania Bitcoinów w 2023 roku potrzeba było ponad 135 TWh[12]. Stanowi to zapotrzebowanie na nieco większe wartości energetyczne niż aktualnie chatGPT, chociaż trzeba zaznaczyć, że są to wartości ruchome. Zgodnie z rys. 2., zapotrzebowanie energetyczne na Bitcoin ma tendencje wzrostową i osiągnęło w historii powyżej 200 TWh w 2022 roku.

Rys. 2. Szacowane zużycie energii związane z działem kryptowaluty BitCoin. Źródło[13].

Rozwiązania energetyczne proponowane przez koncerny

Studia przeprowadzone przez University of Washington wskazują, że przetwarzanie setek milionów zapytań przez ChatGPT może pochłaniać tą samą ilość energii, co 33 tysiące amerykańskich domostw, jak podaje Yahoo! Finance[7].

Korporacje takie jak Google Cloud, Microsoft Azure i Amazon Web Services dokładają starań, aby ich roczne zapotrzebowanie na energię elektryczną było pokrywane przez źródła odnawialne. Microsoft Azure podkreśla, że od 2012 roku zrównoważył swoje emisje dwutlenku węgla, osiągając status neutralności węglowej, a do 2030 roku planuje nawet uzyskać negatywny bilans emisji CO2. Z kolei Amazon zapowiada, że do 2025 roku w pełni przejdzie na energię odnawialną w całej swojej działalności. Google zobowiązał się do osiągnięcia zerowej emisji we wszystkich swoich operacjach do roku 2030[7].

Źródło: pl.freepik.com

Potencjalny wzrost genAI sprawia, że musimy uważać na to, do czego wykorzystujemy sztuczną inteligencję, ponieważ może mieć to różne, dotychczas nieznane nam m.in. społeczne skutki, jak wpływ na interakcję pomiędzy ludźmi[14]. Na pewno, patrząc pod względem konsumpcji, technologia ta jest energochłonna, wiec wg A. de Vries nie chcemy wkładać jej wszędzie tam, gdzie tak naprawdę nie jest potrzebna[1].

Dalsza wizja

Systemy sztucznej inteligencji, by móc osiągnąć większą dokładność swoich modeli, stają się coraz bardziej obszerne. GPT-3, stworzony przez OpenAI, korzysta ze 175 miliardów parametrów, czyli zmiennych, które system AI zdobył podczas wstępnego treningu oraz ciągłego aktualizowania swojej bazy wiedzy. To znaczny wzrost w porównaniu z jego poprzednikiem, który bazował zaledwie na 1,5 miliarda parametrach, natomiast najnowszy chat GPT 4 bazuje na liczbie 100 bilionów parametrów, co pokazuje tempo wzrostu o rzędy wielkości w stosunkowo krótkim czasie[15].

Wraz ze wzrostem dostawców rozwiązań AI i rozmiarów modeli sztucznej inteligencji (głównie LLM) oraz poziomu ich skomplikowania i wielkości bazy treningowej, firmy opracowujące takie rozwiązania powinny koncentrować się, nie tylko nad ich optymalizacją, ale również transparentnością pod względem praw autorskich trenowanych baz. Wskazuje na to wprowadzane na terenie UE AI Act[16], ukazując przy tym wartości zużycia energii w trakcie całej fazy działania.

Bibliografia

1. de Vries A., 2023., The growing energy footprint of artificial intelligence, Joule 7(10): 2191-2194. Pobrano z: https://doi.org/10.1016/j.joule.2023.09.004

4. Żarłoczna inteligencja. Niedługo AI będzie zużywać niewiele mniej energii niż Polska (wp.pl)

5. PSE: Krajowe zużycie energii elektrycznej spadło o 3,44% r/r w 2023 r. – WysokieNapiecie.pl

6. Verdecchia R., Sallou J., Cruz L., 2023, A systematic review of Green AI. WIREs Data Min. &. Knowl. 13(4):1-6. Pobrano z: https://wires.onlinelibrary.wiley.com/doi/epdf/10.1002/widm.1507

8. Artificial intelligence technology behind ChatGPT was built in Iowa — with a lot of water | AP News

9. Mehta C., Cherney M. A., Nellis S., 2023, Nvidia adds jet fuel to AI optimism with record results, $25 billion buyback. Pobrano z: https://www.reuters.com/technology/nvidia-forecasts-third-quarter-revenue-above-wall-street-expectations-2023-08-23/

12. Kryptowaluty: ogromny wpływ na środowisko i klimat – DW – 29.10.2023

13. Bitcoin Energy Consumption Index – Digiconomist

14. Stahl B. C., Eke D., 2023, The ethics of ChatGPT – Exploring the ethical issues of an emerging technology, International Journal of Information Management 74. Pobrano z: https://www.sciencedirect.com/science/article/pii/S0268401223000816?via%3Dihub

15. Link: https://spidersweb.pl/2023/01/gpt-4-nadchodzi.html

16. Link: EU AI Act: first regulation on artificial intelligence | Topics | European Parliament (europa.eu)

17. Zdjęcie tytułowe zostało wygenerowane przez sztuczną inteligencję

Skontaktuj się z nami

Chcesz podzielić się przemyśleniami, do których zainspirował Cię artykuł, zainteresować nas ważną sprawą lub opowiedzieć swoją historię? Napisz do redakcji na adres:

dr inż. Arkadiusz Gaweł

Sekretarz Katedry Kognitywistyki i Modelowania Matematycznego, Kolegium Informatyki Stosowanej. Adiunkt w Katedrze Kognitywistyki i Modelowania Matematycznego Wyższej Szkoły Informatyki i Zarządzania w Rzeszowie. Doktor nauk społecznych w dyscyplinie nauki o komunikacji społecznej i mediach.